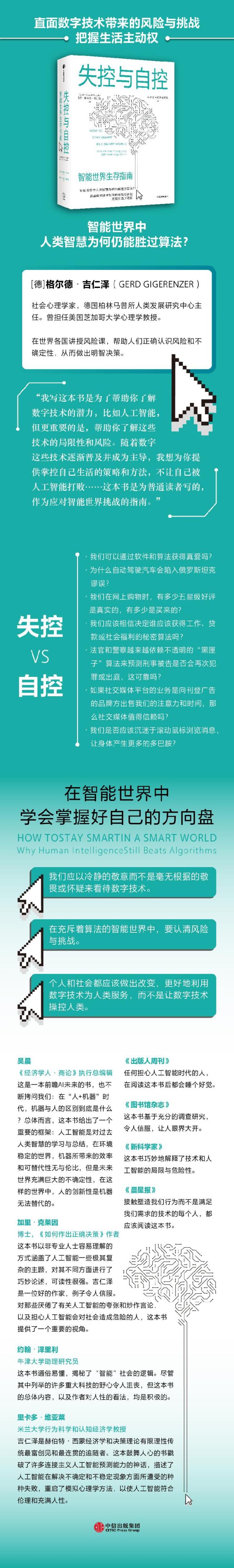

在智能世界,算法和人工智能越来越多地渗透进我们的生活,甚至决定我们的生活,但我们真的了解这些技术的局限和风险吗?本书告诉我们应该如何正确看待数字技术,并为我们提供掌控自己生活的策略和方法,以避免被人工智能掌控。

? 我们可以通过软件和算法获得真爱吗?

? 为什么自动驾驶汽车会陷入俄罗斯坦克谬误?

? 我们在网上购物时,有多少五星级好评是真实的,有多少是买来的?

? 我们应该相信决定谁应该获得工作、贷款或社会福利的秘密算法吗?

? 法官和警察越来越依赖不透明的“黑匣子”算法来预测刑事被告是否会再次犯罪或出庭,这可靠吗?

? 如果社交媒体平台的业务是向刊登广告的品牌方出售我们的注意力和时间,那么社交媒体值得信赖吗?

? 我们是否应该沉迷于滚动鼠标浏览消息,让身体产生 多的多巴胺?

在智能世界,算法和人工智能越来越多地渗透进我们的生活,甚至决定我们的生活,但我们真的了解这些技术的局限和风险吗?本书告诉我们应该如何正确看待数字技术,并为我们提供掌控自己生活的策略和方法,以避免被人工智能掌控。

[德]格尔德·吉仁泽,社会心理学家,德国柏林马普所(Max Planck Institute)人类发展研究中心主任,曾担任美国芝加哥大学心理学教授。在世界各国讲授风险课,帮助人们正确认识风险和不确定性,从而做出明智决策。出版过《风险与好的决策》《直觉思维》等著作。

前?言

部分?人类智能与人工智能

章?点击一下鼠标就能找到真爱?

第二章?人工智能 擅长什么:稳定世界原则

第三章?机器影响我们对智能的看法

第四章?自动驾驶汽车会成为现实吗?

第五章?常识和人工智能

第六章?一个数据点可以击败大数据

第二部分?高昂的代价

第七章?透明度

第八章?梦游着进入监控

第九章?吸引用户的心理效应

第十章?安全和自控

第十一章?真假难辨

致?谢

注?释

参考文献

如果有一个智能助理什么都做得比你好,不管你说什么,它都准确理解,不管你决定什么,它都准确执行,你提出明年的计划后,它会提出一个 好的计划,某些时候,你可能会放弃自己做出的决定。现在是人工智能在有效管理你的财务、填写你的信息、选择你的感情伴侣,并计划你 什么时候生孩子。包裹会送到你家门口,甚至其中一些物品,你都不知道自己需要。社会工作者可能会造访,因为数字助手预测你的孩子有罹患严重抑郁症的风险。你还在为支持哪个政治候选人而苦恼,数字助手已经知道并帮你投好了票。科技公司掌控你的生活只是时间问题,忠实的助手会变成一个 的 智能。我们的孙辈将像一群羊,满含敬畏,对他们的新主人或是欢呼雀跃,或是瑟瑟发抖。

近年来,我在许多热门的人工智能活动上发言,人们对复杂算法广泛无条件的信任,一次次让我震惊。无论主题是什么,科技公司的代表都向听众保证,机器会 准确、 快速、 经济地完成这项工作, 重要的是,用软件代替人工很可能会让世界变得 美好。同样,听说谷歌比我们 了解自己,人工智能几乎可以 地预测我们的行为,或者很快就能做到这一点。在向广告商、保险公司或零售商提供服务时,科技公司就宣布了这种能力。我们也倾向于相信这一点。即使是那些认为机器会带来世界末日的流行作家,以及科技行业 直言不讳的批评者也认为人工智能几乎无所不知,他们将人工智能称为邪恶的监控资本主义,是对人类自由和尊严的恐惧。1正是这种信念让许多人担心Facebook(现在 名为Meta)是一个可怕的奥威尔式监控机器。数据泄露和剑桥分析丑闻将这种担忧放大,让人害怕,让人敬畏。要么出于信仰,要么出于恐惧,但故事情节却保持不变,情节是这样的:

人工智能在 象棋和围棋比赛中击败了 秀的人类。

计算能力每两年翻一番。

因此,机器很快就会比人类做得 好。

我们将此种论调称为“人工智能战胜人类”的论点。它预测机器 智能即将到来。这一论调的两个前提是正确的,结论却是错误的。

因为对于某些类型的问题,计算能力还有很长的路要走,但对于其他问题却没有。迄今为止,人工智能一直是在具有固定规则、定义明确的游戏中获得胜利,例如 象棋和围棋,在相对不变的条件下人脸和语音识别也取得了类似成功。环境稳定时,人工智能可以 人类。如果未来和过去一样,那么海量数据大有用处。然而,如果发生意外,大数据(都是过去的数据)可能会误导我们对未来的看法。大数据算法并没有预测出2008年的金融危机,却预测希拉里·克林顿在2016年获得压倒性胜利。

事实上,我们面临的许多问题并不是定义明确的游戏,而是充满着不确定性,比如寻找真爱、预测谁会犯罪,或者在不可预见的紧急情况下做出反应。在这里,计算能力再强,数据量再大,帮助也是有限的。人类是不确定性的主要来源。想象一下,如果国王可以一时兴起违反规则,而王后可以在放火烧车后跺下棋盘以示抗议,那么 象棋将会变得多么困难。在涉及人的情况下,信任复杂算法会对确定性产生错觉,从而成为灾难的根源。

了解复杂算法在情况稳定时可能会成功,但在不确定的情况下会变得比较困难,这体现了本书的主题:

保持聪慧意味着了解数字技术的潜力和风险,以及在充满算法的世界中保持 地位的决心。

我写这本书是为了帮助你了解数字技术的潜力,比如人工智能,但 重要的是,帮助你了解这些技术的局限性和风险。随着这些技术逐渐普及,成为 ,我想为你提供掌控自己生活的策略和方法,不让自己被人工智能打败。软件做出我们的个人决定时,我们是否应该放任自由?当然不应该。保持聪慧并不意味着 信任技术,也不意味着充满焦虑, 不信任技术。相反,这本书旨在帮助读者了解人工智能可以做什么,揭示有关营销炒作和技术宗教信仰的幻想有何问题。同时,本书还讨论了如何让人类控制设备,而不是被设备远程控制。

保持聪慧与掌握数字技能以使用技术不同。世界各地的教育项目都试图通过为教室购买平板电脑和智能白板,并教孩子们如何使用这些设备来提高数字技能。但这些项目很少教孩子们如何理解数字技术带来的风险。结果,令人震惊的是,多数数字原住民(自幼就熟悉信息技术的人)无法将隐藏广告与真实新闻区分开来,而是被网站的外观所吸引。例如,一项针对3,446名数字原住民的研究表明,96%的人不知道如何检查网站和帖子的可信度。2

智能世界不仅仅是在我们的生活中增添智能电视、在线约会和其他花招噱头。这是一个被数字技术改变的世界。当智能世界的大门 次打开,许多人将其描绘为一个人人都能接触到真实信息之树的天堂, 终将终结无知、谎言和腐败,将公开有关气候变化、恐怖主义、逃税、剥削穷人和侵犯人类尊严的事实,将揭露不道德的政客和贪婪的行政人员,使他们被迫辞职,将防止政府监控公众和侵犯公众隐私。虽然天堂也被污染了,但在某种程度上,这个梦想已经成为现实。然而,真正巨大的变化却是社会变革。世界不会简单地变得 好或 坏,我们对好与坏的看法正在发生变化。例如,不久前,人们 关注隐私,走上街头抗议政府和公司试图监控他们并掌握其个人数据。各种活动家、年轻的自由主义者和主流组织对1987年德国人口普查进行了大规模抗议,担心计算机可以将他们的答案去匿名化,愤怒的人们在柏林墙上贴满了数千份空白问卷。2001年的澳大利亚人口普查中,超过70,000人宣布其宗教为“ 地武士”(取自电影《星球大战》)。2011年,英国公民抗议政府侵犯他们隐私的问题,如宗教信仰问题。3 ,智能家居每周七天每天24小时全天候记录我们所做的一切,包括我们在卧室里的活动,孩子们的智能玩偶记录了它所托付的每一个秘密,这种情况下我们却只是耸了耸肩。人们对隐私和尊严的感受在随技术而变化,这两个词有可能成为过去的概念。互联网的梦想曾经是自由;对许多人来说,自由现在意味着不受约束的互联网。

自古以来,人类创造了许多惊人的新技术,但人类并不总是明智地使用这些技术。为了获得数字技术的诸多好处,我们需要洞察力和勇气,以在智能世界中保持聪慧。不要再放任自由,是时候睁大眼睛并维持掌控了。

……

技术专制

专制/家长制(来自拉丁词pater,“父亲”)是指这样一种观点,即一个选定的群体有权像对待孩子一样对待他人,后者应该愿意服从该群体的 。从历 看,统治集团是上帝选择的,是贵族的一部分,拥有秘密的知识或华丽的财富。这给专制的存在做出了合理的解释。他们权力之下的人被认为低人一等,因为他们是女性、有色人种、穷人或未受过教育的人群等。20世纪,在 大多数人终于有机会学习阅读和写作之后,在政府 终授予男性和女性言论和行动自由以及投票权之后,专制作风逐渐退却。这场革命中坚定的支持者锒铛入狱或献出生命,才使得包括我们在内的下一代能够自己掌握命运。然而,在21世纪,科技公司正见证一种新的专制的兴起,无论我们是否同意,这些公司正在使用机器来预测和操纵我们的行为。倡导者甚至宣布新的上帝即将到来,即一种被称为“通用人工智能(AGI)”的无所不知的 智能,据说在脑力的各个方面都超过了人类。在它到来之前,我们应该听从他的预言家们。22

技术解决主义认为每个社会问题都是一个“错误”,需要通过算法“修复”。技术专制是其自然结果,需要通过算法进行治理。它不需要兜售 智能的传说;相反,它希望我们接受公司和政府每时每刻记录我们在哪里、我们在做什么以及与谁一起的行为,并相信这些记录将使世界变得 美好。正如谷歌的前总裁埃里克施密特(EricSchmidt)解释的那样,“我们的目标是让谷歌用户能够提出诸如‘我明天应该做什么’和‘我应该从事什么工作?’之类的问题。”23不少广受欢迎的作家通过讲述充其量是符合事实的故事来激起我们对技术专制的敬畏。24 令人惊讶的是,即使是一些有影响力的研究人员也认为人工智能的能力没有限制,他们认为人脑只是一台劣等计算机,我们应该尽可能用算法代替人脑。25人工智能会告诉我们该做什么,我们应该倾听并遵循。我们只需要稍等片刻,等待人工智能变得 聪明。奇怪的是,这 不是说人们也需要变得 聪明。

我写这本书是为了让读者对人工智能能做什么,以及它如何影响我们有一个现实的认识。我们不需要 多的技术专制;在过去几个世纪里,我们已经承受得太多。但我们也不需要恐惧技术,每一项突破性技术都会使这种恐慌重新出现。火车发明时,医生警告说乘客会死于窒息。26收音机广泛使用时,人们担心听得太多会伤害孩子,因为他们需要的是休息,而不是爵士乐。27数字世界需要的不是恐惧或炒作,而是需要消息灵通、理性批判的公民,他们希望将自己的生活掌握在自己手中。

这本书不是对人工智能或其子领域(如机器学习和大数据分析)的学术介绍。相反,它是关于人类与人工智能的关系:关于信任、欺骗、理解、成瘾以及个人和社会转型的探讨。它是为普通读者编写的,作为应对智能世界挑战的指南,其中借鉴了我自己的研究,包括马克斯·普朗克人类发展研究所的不确定性下的决策研究,这个话题一直让我着迷。在写作过程中,我并不掩饰个人对自由和尊严的看法,但我尽可能呈现客观证据,让读者自己做出判断。我坚信,只要我们继续保持活跃,并利用我们在复杂进化过程中发展起来的大脑,人类并不像人们常说的那样愚蠢和无能。尤其促使我写这本书的是,人工智能击败人类的负面叙述,我们被动地同意让政府或机器按照他们的条件“优化”我们的生活,这些危险与日俱增。跟我以前的书《直觉和风险意识》一样,这本书是一种充满 的呼吁,以弘扬来之不易的个人自由和民主活力。

在 和不久的将来,我们面临着专制和民主两种制度之间的冲突,这与冷战没有什么区别。然而,与那个时代不同,当核技术在两种力量之间保持不稳定的平衡时,数字技术很容易将天平向专制系统倾斜。我们已经在新冠病毒大流行期间看到了这种情况,当时一些 在严格的数字监控系统的帮助下成功地控制了病毒。

我无法顾及与数字化领域相关的方方面面,但我会利用一些主题来解释可以 广泛应用的普遍原则,例如第2章中讨论的环境稳定原则和得克萨斯神 手谬误,以及第4章讨论的适应人工智能原理和俄罗斯坦克谬误。你可能已经注意到,我是在广义上使用“人工智能”这一术语,包括旨在完成人类智能所做的任何类型的算法,但我会在必要时进行区分。

在每种文化中,我们都需要谈论我们和我们的孩子希望生活的未来世界。答案不是 的,但有一句话适用于所有愿景。尽管有了技术创新,或者说正因为技术创新,我们比以往任何时候都需要 多地使用大脑。

让我们从我们 关心的问题开始,寻找真爱,并从简单到每个人都能理解的秘密算法开始。